上海交通大学密西根学院教师贺玉莲课题组最新研究成果在《自然·通讯》发布

近日,上海交通大学密西根学院副教授贺玉莲课题组与瑞士洛桑联邦理工学院(EPFL)助理教授Philippe Schwaller教授团队合作,在国际权威期刊《自然·通讯》(Nature Communications)发表题为A multi-modal transformer for predicting global minimum adsorption energy(用于预测全局最低吸附能的多模态Transformer模型)的研究论文。论文提出了一种结合表面图与吸附物描述符的Transformer模型(AdsMT),为大规模催化剂虚拟筛选提供了高效、无吸附位点信息依赖的解决方案。

在催化剂设计与高通量虚拟筛选中,全局最低吸附能(GMAE)被广泛用作衡量催化剂活性与选择性的重要物理量。尽管基于密度泛函理论(DFT)的方法在计算精度上具有优势,但在面对复杂催化剂表面与多种吸附物组合时,所需枚举大量吸附位点与构型,计算成本高昂、效率低下,严重制约了大规模催化材料的筛选进程。

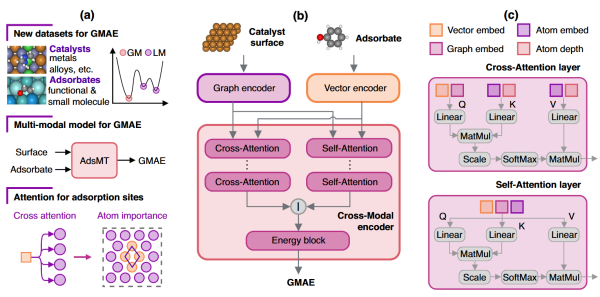

针对上述挑战,两校合作团队开发了多模态Transformer模型AdsMT,可在无需提供吸附位点信息的前提下,直接从催化剂表面图结构与吸附物分子描述符出发,快速预测GMAE。此外,AdsMT 相较于密度泛函理论(DFT)计算,预测速度提升了约 8 个数量级,相比结合启发式搜索的机器学习原子间势(MLIP)方法也快了约 4 个数量级。该模型利用交叉注意力机制学习表面原子与吸附物之间的复杂交互关系,从而避免传统模型对吸附结构的穷举枚举。研究团队构建并测试了三个具有代表性的GMAE数据集(Alloy-GMAE、FG-GMAE、OCD-GMAE),涵盖金属合金、功能团吸附物与复杂无机表面等多种化学空间。AdsMT在上述数据集中的平均绝对误差(MAE)分别达到0.09eV、0.14eV和0.39eV的准确率,表现优于现有的图神经网络模型,且在不需要吸附位点信息的条件下,成功率达70%以上。同时,AdsMT具备良好的可解释性,其注意力权重可用来识别最有可能的吸附位点,与DFT计算结果高度一致。

AdsMT模型实现了在无需吸附构型输入的前提下,对GMAE的高效、精准、可解释预测,是当前催化领域深度学习应用的重要突破,展现出强大的潜力,有望加速绿色能源、CO2转化等关键领域的催化材料发现。

贺玉莲、Philippe Schwalle是此篇论文的共同通讯作者,论文共同第一作者包括中方团队的博士生黄旭和瑞士方团队的博士生陈俊武,合作作者为交大安泰经济与管理学院副教授花成。

作者简介

黄旭,上海交通大学化学工程学士(2023届),目前于美国加利福尼亚大学伯克利分校材料科学与工程专业攻读博士研究生。

贺玉莲,上海交通大学密西根学院、化学化工学院双聘副教授。毕业于耶鲁大学并获得博士学位。研究方向涵盖催化剂合成与设计,碳一催化,多相催化,构效关系,催化氧化,加氢反应,数据驱动催化剂理性设计等领域。